Mejorar la calidad de datos: guía práctica para empresas

La mala calidad de datos es uno de los errores más costosos que las empresas aceptan en silencio. No porque no noten el daño, sino porque este se distribuye en decenas de procesos y rara vez aparece como una partida individual. Direcciones incorrectas, contactos obsoletos, formatos inconsistentes: las consecuencias van desde correo duplicado hasta oportunidades de venta perdidas y multas según el RGPD.

Gartner estima que el coste medio de una mala calidad de datos asciende a 12,9 millones de dólares al año por empresa. Incluso si solo una fracción le afecta: con una base de direcciones de 20.000 entradas, las devoluciones, el franqueo duplicado y las correcciones manuales suman rápidamente cifras de cinco dígitos.

Este artículo explica qué significa realmente la calidad de datos, qué dimensiones medir y cómo mejorarla de forma sostenible en cinco pasos.

Qué significa realmente la calidad de datos

La calidad de datos no es un estado binario. No se trata de si sus datos son "buenos" o "malos". La calidad de datos describe en qué medida sus datos son aptos para el uso previsto.

Para el envío postal, una dirección debe ser postalmente correcta y entregable. Para el marketing, además hay que saber si existe un consentimiento. Para la contabilidad, importa la razón social exacta. Los mismos datos pueden ser suficientes para un fin e inadecuados para otro.

Seis dimensiones definen la calidad de datos:

| Dimensión | Significado | Ejemplo |

|---|---|---|

| Exactitud | ¿Coinciden los datos con la realidad? | El código postal 28001 pertenece efectivamente a Madrid |

| Completitud | ¿Están rellenos todos los campos obligatorios? | Una dirección sin número es incompleta |

| Consistencia | ¿Se representan los mismos hechos de forma idéntica? | "C/", "Calle", "c/" |

| Actualidad | ¿Reflejan los datos el estado actual? | ¿Sigue siendo correcta la dirección tras una mudanza? |

| Unicidad | ¿Está cada entidad registrada exactamente una vez? | Sin duplicados por persona |

| Conformidad | ¿Cumplen los datos las reglas formales? | Los códigos postales en Alemania tienen exactamente 5 dígitos |

Por qué la calidad de datos se deteriora progresivamente

Las bases de direcciones no se degradan de un día para otro. El deterioro ocurre lentamente y en múltiples niveles simultáneamente:

Obsolescencia natural: Solo en Alemania, unos 8,5 millones de personas se mudan cada año. Para una base de datos con 50.000 contactos, esto significa estadísticamente que unas 5.000 direcciones se vuelven inválidas por año, sin que nadie cometa un error.

Errores de entrada: Toda entrada manual de datos es propensa a errores. Erratas en nombres de calles, dígitos invertidos en códigos postales, caracteres especiales olvidados. Los estudios muestran que entre el 1 y el 4 por ciento de los campos contienen errores tras la entrada manual.

Fusión de fuentes: Cuando CRM, herramienta de newsletter y contabilidad mantienen bases de direcciones separadas que luego se fusionan, los duplicados son inevitables. El mismo cliente aparece como "Max Müller" en el CRM y "Mueller, Max" en la dirección de facturación. Para resolver este tipo de problemas de forma sistemática, consulte nuestra guía para limpiar datos de CRM.

Falta de procesos: Sin reglas definidas para la entrada de datos y una limpieza regular, el caos crece con cada nuevo registro.

Ejemplo: Obsolescencia natural en 3 años

──────────────────────────────────────────

Punto de partida: 50.000 direcciones, 95% correctas

Tras 1 año: 50.000 direcciones, ~85% correctas (5.000 mudanzas + 500 errores)

Tras 2 años: 50.000 direcciones, ~76% correctas

Tras 3 años: 50.000 direcciones, ~68% correctas

→ Casi una de cada tres direcciones es incorrecta tras 3 años

Los cinco pasos hacia una mejor calidad de datos

Paso 1: Diagnóstico – ¿dónde se encuentra?

Antes de mejorar, hay que medir. Extraiga una muestra de 500 a 1.000 registros y compruébelos según las seis dimensiones:

- ¿Cuántas direcciones están completas (todos los campos obligatorios rellenos)?

- ¿Cuántos códigos postales son formalmente correctos?

- ¿Cuántos duplicados encuentra en la muestra?

- ¿Cuántas direcciones presentan formatos inconsistentes?

Documente los resultados. Necesita este valor de referencia para medir el impacto de sus mejoras.

Paso 2: Normalización – crear formatos uniformes

La normalización lleva los datos existentes a un formato uniforme sin cambiar su contenido:

| Antes | Después | Regla |

|---|---|---|

| C/, Calle, calle | Calle | Resolver abreviaturas |

| MÜLLER, Max | Müller, Max | Corregir mayúsculas/minúsculas |

| 0711/1234567 | 07111234567 | Eliminar caracteres especiales |

| " Max Müller " | "Max Müller" | Eliminar espacios sobrantes |

| Dr. med. Max Müller | Max Müller (Título: Dr. med.) | Separar títulos |

La normalización es el requisito previo para todos los pasos siguientes. Sin formatos coherentes, cualquier comprobación de duplicados produce errores porque las diferencias de formato se interpretan erróneamente como diferencias de contenido.

Paso 3: Identificar y fusionar duplicados

Los duplicados son el defecto de calidad más frecuente y costoso. En una base de datos empresarial típica, entre el 8 y el 15 por ciento de todas las entradas están duplicadas. Una guía detallada se encuentra en nuestro artículo Encontrar direcciones duplicadas. Para usuarios de hojas de cálculo, nuestra guía explica cómo eliminar duplicados de direcciones en Excel de forma eficaz.

Escenario típico de duplicados:

──────────────────────────────

Entrada A: Max Müller | Hauptstraße 12 | 70173 Stuttgart

Entrada B: Mueller, Max | Hauptstr. 12 | 70173 Stuttgart

Entrada C: Dr. Max Müller| Hauptstrasse 12 | 70173 Stuttgart

→ Tres entradas, una sola persona

→ Tres cartas por envío

→ Tres veces los gastos de franqueo

Una detección fiable de duplicados combina varios métodos: algoritmos fonéticos para variantes de nombres, coincidencia difusa (fuzzy matching) para erratas y comparación ponderada de campos para la evaluación global. Más información en nuestro artículo Detectar duplicados: 7 métodos para datos de direcciones limpios.

Paso 4: Validación – ¿son correctos los datos?

Tras la normalización y la deduplicación viene la verificación del contenido:

Validación código postal-ciudad: ¿Corresponde el código postal a la ciudad indicada? Una comprobación automatizada detecta inmediatamente errores como "70173 Múnich" (correcto: Stuttgart).

Validación de calles: ¿Existe la calle indicada en la zona del código postal? Este método requiere directorios de calles actualizados, pero permite identificar muchas erratas y nombres de calles obsoletos.

Comprobaciones de formato: ¿Tiene el código postal exactamente 5 dígitos? ¿Empieza el número de casa con un dígito? ¿Contiene el campo de correo electrónico un @?

Validación: Resultados tipo

────────────────────────────────

50.000 registros comprobados:

✓ 43.500 direcciones válidas (87%)

✗ 3.200 conflictos código postal-ciudad (6,4%)

✗ 1.800 campos obligatorios ausentes (3,6%)

✗ 1.500 formatos inválidos (3%)

Paso 5: Establecer procesos – asegurar la calidad permanentemente

Una limpieza puntual no es suficiente. Sin procesos, la calidad de datos vuelve a caer al nivel anterior en pocos meses. Tres medidas marcan la diferencia:

Definir reglas de entrada: Fijar campos obligatorios, especificar formatos de entrada, imponer validación en el punto de entrada. Si el CRM solo acepta códigos postales válidos, no pueden producirse errores de código postal.

Ciclos regulares de limpieza: Realizar una comprobación completa de duplicados y normalización al menos una vez por trimestre. Para bases de datos con alto volumen de entrada, mensualmente.

Gestión de devoluciones: Cada envío no entregable es una señal. Registrar sistemáticamente las devoluciones, marcar las direcciones afectadas y priorizarlas en el siguiente ciclo de limpieza.

Lo que realmente cuesta la mala calidad de datos

Los costes pueden calcularse con un escenario concreto:

Empresa: Empresa de venta por correo de tamaño mediano, 40.000 direcciones, envíos mensuales por Dialogpost.

| Factor de coste | Cálculo | Coste anual |

|---|---|---|

| Duplicados (12%) | 4.800 × 12 envíos × 0,28 EUR | 16.128 EUR |

| Devoluciones (6%) | 2.400 × 12 envíos × 0,28 EUR | 8.064 EUR |

| Correcciones manuales | 200 h × 35 EUR/h | 7.000 EUR |

| Leads perdidos | aprox. 2% menos de respuestas | difícil de cuantificar |

| Total | >31.000 EUR |

En comparación, el coste de una limpieza profesional regular representa solo una fracción de esa cantidad.

La calidad de datos como ventaja competitiva

Una buena calidad de datos no se limita a evitar costes. Permite acciones que simplemente no funcionan con datos deficientes:

Personalización: Las cartas personalizadas requieren que el nombre, el género y el saludo sean correctos. "Estimada Sra. Max Müller" es más vergonzoso que no personalizar en absoluto.

Segmentación: Las campañas regionales, los análisis de público objetivo y el scoring de clientes dependen de datos correctos. Con un 15 por ciento de duplicados, los resultados de cualquier segmentación están distorsionados.

Cumplimiento RGPD: El RGPD exige la exactitud de los datos personales (art. 5, apartado 1, letra d). Trabajar conscientemente con datos obsoletos expone a multas. Para más detalles, consulte nuestro artículo sobre limpieza de direcciones conforme al RGPD. Un panorama completo de los requisitos del RGPD para datos de direcciones se encuentra en nuestro artículo dedicado.

Eficiencia: Los datos limpios aceleran cada proceso: desde el envío de correo hasta la facturación y la atención al cliente. Menos consultas, menos correcciones manuales, menos fricción.

Herramientas y automatización

La limpieza manual de una base de direcciones con decenas de miles de entradas es posible pero antieconómica. A partir de cierto tamaño, no hay alternativa a las herramientas automatizadas.

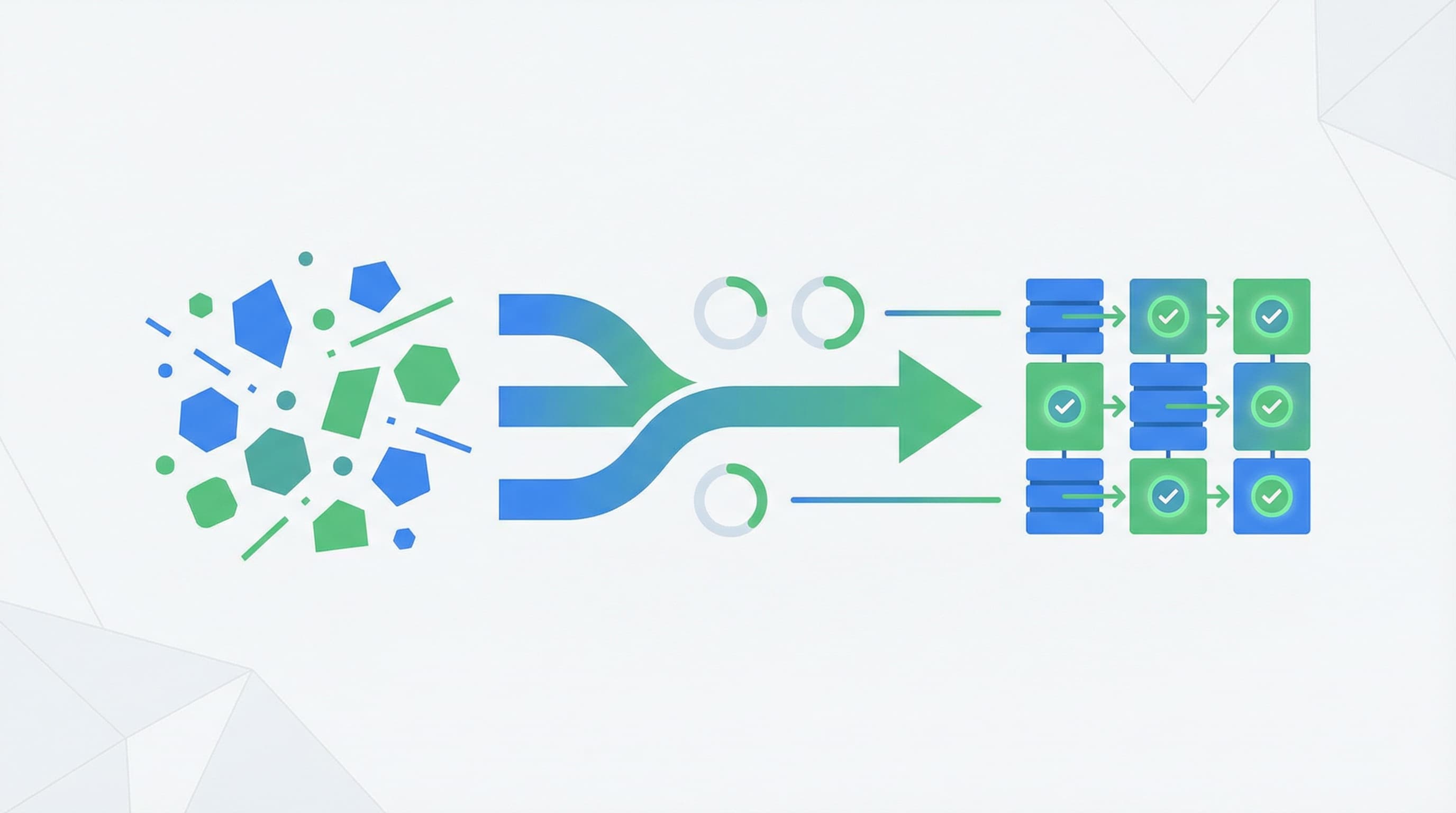

Las soluciones profesionales como ListenFix combinan normalización, detección de duplicados con cinco algoritmos diferentes y validación de códigos postales en un solo paso. La ventaja clave: todo el procesamiento se realiza localmente, sin transmitir datos de direcciones a servidores externos. Para empresas con requisitos estrictos de protección de datos, esta es una ventaja decisiva.

El proceso es sencillo: suba su archivo CSV o Excel, asigne las columnas, inicie la limpieza. En pocos segundos recibirá un archivo limpio con un registro de todos los cambios.

La calidad de datos necesita constancia, no perfección

El 100 por ciento de calidad de datos es un objetivo inalcanzable. La gente se muda, las empresas cambian de nombre y los errores se cuelan con cada entrada. El objetivo no es la perfección sino un nivel de calidad suficiente para sus procesos de negocio, y medidas que mantengan ese nivel en el tiempo.

La estrategia más eficaz: pequeñas mejoras regulares en lugar de un gran proyecto puntual. Una comprobación trimestral de duplicados seguida de normalización mantiene estable su calidad de datos. Si además define reglas de entrada y evalúa sistemáticamente las devoluciones, la calidad mejora con cada ciclo.

Comience con el diagnóstico. Mida dónde se encuentra. Y luego mejore paso a paso, con procesos claros y las herramientas adecuadas.

Limpia tus direcciones — pruébalo ahora

ListenFix detecta significativamente más duplicados que Excel gracias al fuzzy matching. 100% sin conexión, compatible con RGPD.

Probar gratis